NVIDIA ConnectX-6 InfiniBand Adapter MCX653105A-HDAT ¢ 200Gb/s Crittografia hardware RDMA

Dettagli:

| Marca: | Mellanox |

| Numero di modello: | MCX653106A-HDAT-SP |

| Documento: | connectx-6-infiniband.pdf |

Termini di pagamento e spedizione:

| Quantità di ordine minimo: | 1 pz |

|---|---|

| Prezzo: | Negotiate |

| Imballaggi particolari: | Scatola esterna |

| Tempi di consegna: | Basato sull'inventario |

| Termini di pagamento: | T/T |

| Capacità di alimentazione: | Fornitura per progetto/batch |

|

Informazioni dettagliate |

|||

| Stato dei prodotti: | Azione | Applicazione: | Server |

|---|---|---|---|

| Condizione: | Nuovo e originale | Tipo: | Cablato |

| Velocità massima: | Fino a 200 GB/s | Connettore Ethernet: | QSFP56 |

| Modello: | MCX653106A-HDAT | Nome: | Cassaforte astuta ad alta velocità della scheda di rete 200gbe di MCX653106A-HDAT-SP Mellanox |

Descrizione di prodotto

MCX653105A-HDAT – Singola porta 200Gb/s

Progettata per infrastrutture cloud HPC, AI e hyperscale esigenti, la scheda smart adapter NVIDIA® ConnectX®-6 MCX653105A-HDAT offre banda 200Gb/s su una singola porta QSFP56 con accelerazione In-Network Computing. Scaricando attività critiche di spostamento dati e sicurezza dalla CPU, migliora drasticamente efficienza, scalabilità e sicurezza — dall'addestramento di reti neurali profonde all'analisi dati in tempo reale e allo storage NVMe-oF.

Come componente fondamentale della piattaforma NVIDIA Quantum InfiniBand, ConnectX-6 abilita RDMA end-to-end, trasporto affidabile basato su hardware e controllo avanzato della congestione. Il modello MCX653105A-HDAT a porta singola offre un ingresso conveniente ma potente nelle reti InfiniBand HDR a 200Gb/s e reti 200GbE. Integra crittografia XTS-AES a livello di blocco, offload NVMe over Fabrics (NVMe-oF) e accelerazione GPUDirect RDMA — rendendolo la scelta ideale per cluster accelerati da GPU, storage definito dal software e ambienti di trading ad alta frequenza dove bassa latenza e sicurezza sono fondamentali.

NVIDIA ConnectX-6 estende il Remote Direct Memory Access (RDMA) oltre i limiti convenzionali. Implementando offload hardware per il tag matching MPI, RDMA fuori ordine che supporta Adaptive Routing e Dynamically Connected Transport (DCT), garantisce una scalabilità efficiente su migliaia di nodi. La capacità In-Network Memory della scheda abilita l'accesso alla memoria RDMA senza registrazione, riducendo l'overhead del software. Combinato con PCIe Gen 4.0, i dati si spostano direttamente tra memoria e rete, liberando cicli CPU per la logica applicativa. Inoltre, il trasporto affidabile basato su hardware e il controllo di flusso a livello di pacchetto end-to-end garantiscono l'integrità dei dati anche sotto carico estremo.

Con supporto per RoCE (RDMA over Converged Ethernet), offload di tunneling di rete overlay e coalescenza intelligente degli interrupt, ConnectX-6 fornisce un fabric intelligente unificato sia per ambienti InfiniBand che Ethernet.

- High Performance Computing (HPC): Simulazioni su larga scala, modellazione meteorologica, chimica computazionale che richiedono bassa latenza deterministica.

- AI & Machine Learning: Accelerare l'addestramento distribuito di reti neurali profonde con GPUDirect RDMA e throughput 200Gb/s.

- Array di storage NVMe-oF: Costruire target di storage NVMe/TCP o NVMe/RDMA ad alte prestazioni con offload hardware, riducendo il carico CPU fino al 30%.

- Cloud Hyperscale & NFV: Efficiente service chaining, offload OVS (ASAP²), e SR-IOV per fino a 1K funzioni virtuali.

- Servizi Finanziari & Trading: Distribuzione dati di mercato a latenza ultra-bassa e infrastruttura di trading algoritmico.

ConnectX-6 MCX653105A-HDAT è compatibile con un'ampia gamma di server, switch e ambienti OS. Supporta switch InfiniBand fino a 200Gb/s (HDR) e switch Ethernet fino a 200Gb/s con auto-negoziazione e tutte le modalità FEC. La scheda funziona su piattaforme basate su x86, Power, Arm, GPU e FPGA.

| Categoria | Opzioni / Standard supportati |

|---|---|

| Sistemi Operativi | RHEL, SLES, Ubuntu, altre principali distribuzioni Linux, Windows Server, FreeBSD, VMware vSphere |

| Specifiche InfiniBand | Conforme a IBTA 1.3, 200/100/50/25/10Gb/s, 8 virtual lane + VL15, controllo congestione basato su hardware |

| Standard Ethernet | 200/100/50/40/25/10/1GbE, IEEE 802.3bj, 802.3by, 802.3ba, PFC, ETS, DCB, 1588v2, Jumbo frame (9.6KB) |

| Offload CPU & Virtualizzazione | SR-IOV (fino a 1K VF), NPAR, DPDK, offload OVS ASAP², incapsulamento/decapsulamento tunnel (VXLAN, NVGRE, Geneve) |

| Gestione & Boot | NC-SI, MCTP su SMBus/PCIe, PLDM (DSP0248/DSP0267), UEFI, PXE, boot remoto iSCSI, boot remoto InfiniBand |

| Parametro | Dettaglio |

|---|---|

| Modello prodotto | MCX653105A-HDAT |

| Form Factor | PCIe Stand-up, staffa low-profile inclusa, staffa alta montata, staffa corta come accessorio |

| Porte di rete | 1x QSFP56 (singola porta) |

| Velocità supportate (InfiniBand) | 200/100/50/25/10 Gb/s |

| Velocità supportate (Ethernet) | 200/100/50/40/25/10/1 Gb/s |

| Interfaccia Host | PCIe Gen 3.0/4.0 x16 (supporta anche x8, x4, x2, x1) |

| Larghezza di banda massima | 200Gb/s |

| Tasso di messaggi | Fino a 215 milioni di messaggi al secondo |

| Latenza | Estremamente bassa (RDMA sub-microsecondo) |

| Crittografia hardware | Crittografia a livello di blocco XTS-AES 256/512 bit, FIPS capable |

| Offload storage | Target/initiator NVMe-oF, T10-DIF, SRP, iSER, NFS RDMA, SMB Direct |

| Virtualizzazione | SR-IOV (fino a 1K VF), VMware NetQueue, QoS per VM |

| Boot remoto | InfiniBand, Ethernet, iSCSI, UEFI, PXE |

| Dimensioni (senza staffa) | 167.65mm x 68.90mm |

| RoHS & Conformità | Conforme a RoHS, compatibile ODCC |

| Numero parte di ordinazione (OPN) | Porte / Velocità | Interfaccia Host | Caratteristiche principali |

|---|---|---|---|

| MCX653105A-HDAT | 1x QSFP56, fino a 200Gb/s | PCIe 3.0/4.0 x16 | Singola porta, supporto crittografia, staffa standard |

| MCX653106A-HDAT | 2x QSFP56, fino a 200Gb/s | PCIe 3.0/4.0 x16 | Doppia porta, supporto crittografia |

| MCX653105A-ECAT | 1x QSFP56, fino a 100Gb/s | PCIe 3.0/4.0 x16 | Variante 100Gb/s, nessuna crittografia |

| MCX653435A-HDAT (OCP 3.0) | 1x QSFP56, 200Gb/s | PCIe x16 | Formato ridotto OCP 3.0 |

| MCX654105A-HCAT | 1x QSFP56, Socket Direct | 2x PCIe 3.0 x16 | Socket Direct con accesso CPU dedicato |

Nota: Per varianti a piastra fredda per Intel Server System D50TNP raffreddato a liquido, contattare Starsurge per ordini personalizzati.

Adattatori NVIDIA ConnectX-6 autentici al 100% con tracciabilità completa del lotto.

Hub di magazzino in Asia, Europa e Americhe che servono oltre 50 paesi.

Configurazione firmware, tuning RDMA, validazione NVMe-oF, assistenza driver.

Partnership a lungo termine con distributori NVIDIA, sconti volume disponibili.

Sostituzione senza problemi e cross-ship avanzato per implementazioni critiche.

Supporto inglese, cinese, giapponese; servizi di integrazione e etichettatura personalizzati.

Hong Kong Starsurge Group fornisce supporto end-to-end: da controlli di compatibilità, personalizzazione firmware, a guida all'installazione in loco. Offriamo account manager tecnici dedicati per aggiornamenti di data center e test di proof-of-concept (PoC). Tutte le schede vengono spedite con imballaggio antistatico e kit di installazione opzionali.

Le offerte di supporto includono: Sistema di ticketing di supporto tecnico 24/5, sostituzione avanzata per ambienti business-critical, assistenza driver e stack software (OFED, WinOF-2, DPDK), e troubleshooting remoto.

- Confermare lo spazio meccanico del server: staffa PCIe ad altezza standard inclusa; staffa low-profile fornita anche come accessorio.

- Per piattaforme raffreddate a liquido (Intel D50TNP), verificare la disponibilità dell'opzione piastra fredda prima di ordinare — la staffa standard raffreddata ad aria è predefinita.

- Si prega di confermare la compatibilità del driver con la versione della propria distribuzione Linux — NVIDIA MLNX_OFED consigliato per prestazioni ottimali.

- Non specificato pubblicamente: Consumo energetico esatto a pieno carico 200Gb/s — fare riferimento al manuale utente NVIDIA o contattare Starsurge per valori tipici (circa 13-16W).

- La certificazione FIPS è hardware-capable ma potrebbe richiedere una versione firmware specifica — notificare al team di vendita se la conformità FIPS è obbligatoria per la vostra implementazione.

- L'adattatore a porta singola non può essere utilizzato per la ridondanza delle porte; per progetti ad alta disponibilità, considerare il modello a doppia porta MCX653106A-HDAT.

Fondata nel 2008, Hong Kong Starsurge Group Co., Limited è un fornitore tecnologico di hardware di rete, servizi IT e soluzioni di integrazione di sistemi. Con una base clienti globale che spazia nei settori governativo, sanitario, manifatturiero, educativo, finanziario e aziendale, Starsurge fornisce apparecchiature di rete ad alte prestazioni tra cui switch, NIC, soluzioni wireless e software personalizzati. L'azienda combina team di vendita e tecnici esperti per supportare progetti di infrastrutture complesse, implementazioni IoT e sistemi di gestione di rete. L'approccio orientato al cliente, la qualità affidabile e la consegna globale reattiva rendono Starsurge un partner fidato per i data center di nuova generazione.

Contatta il team Starsurge →| Fatto | Valore |

|---|---|

| Throughput massimo | 200Gb/s (singola porta) |

| Motori di accelerazione on-chip | Tag matching, offload rendezvous, offload collettivi, offload burst buffer |

| Funzioni virtuali massime | Fino a 1024 VF per adattatore |

| Standard di crittografia | XTS-AES 256/512 bit, offload hardware dalla CPU |

| Supporto Adaptive Routing | RDMA fuori ordine con Adaptive Routing |

| In-Network Memory | Accesso alla memoria RDMA senza registrazione |

| Server / Piattaforma | Architettura CPU | OS / Ambiente testato |

|---|---|---|

| Dell PowerEdge R750/R760 | Intel Xeon Scalable Gen 3/4 | RHEL 8.6+, Ubuntu 22.04, VMware ESXi 7.0/8.0 |

| HPE ProLiant DL380 Gen10/Gen11 | Intel Xeon | SLES 15 SP4, Windows Server 2022 |

| Supermicro Ultra SuperServer | AMD EPYC 7002/7003 | Ubuntu 20.04/22.04, Rocky Linux 8 |

| Lenovo ThinkSystem SR650/SR655 | Intel / AMD EPYC | RHEL 9, Windows Server 2019 |

| NVIDIA DGX A100 / H100 | x86_64 / NVIDIA Arm | Ubuntu con MLNX_OFED, NVIDIA HPC SDK |

- ☑ Disponibilità slot PCIe: x16 meccanico (supportato elettricamente x16/x8/x4)

- ☑ Velocità porta richiesta: 200Gb/s o inferiore; tipo cavo (QSFP56 DAC passivo o ottica attiva)

- ☑ Versione driver OS: Verificare la compatibilità MLNX_OFED o WinOF-2 con il proprio kernel

- ☑ Requisito crittografia: AES-XTS standard o modalità FIPS (firmware speciale)

- ☑ Raffreddamento e staffa: Raffreddamento ad aria standard o opzione piastra fredda per raffreddamento a liquido

- ☑ Quantità e tempi di consegna: Conferma stock con il team di vendita Starsurge

- ☑ Applicazione prevista: Sufficiente porta singola, o necessità di ridondanza a doppia porta?

Serie QM8700 / QM9700, 40 porte HDR 200Gb/s, completamente gestiti

Ottimizzato per Ethernet e RoCE, 200Gb/s a basso consumo energetico

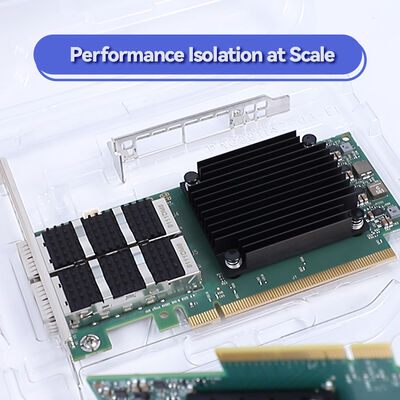

InfiniBand/Ethernet con data path programmabile e isolamento

Cavi DAC, AOC e fibra attiva per 200G QSFP56

- ▸ Manuale utente NVIDIA ConnectX-6 (Guida firmware e configurazione)

- ▸ Best Practice per l'implementazione di RDMA over Converged Ethernet (RoCE)

- ▸ NVMe-oF con ConnectX-6: Guida all'ottimizzazione delle prestazioni

- ▸ GPUDirect RDMA per cluster AI – Panoramica tecnica

- ▸ Configurazione crittografia a livello di blocco per ambienti FIPS