Cavo splitter AOC a bassa latenza NVIDIA MFS1S50-H010E da 200G a 2x100G QSFP56

Dettagli:

| Marca: | Mellanox |

| Numero di modello: | MFS1S50-H010E |

| Documento: | MFS1S50-H0xxV.pdf |

Termini di pagamento e spedizione:

| Quantità di ordine minimo: | 1 pz |

|---|---|

| Prezzo: | Negotiate |

| Imballaggi particolari: | Scatola esterna |

| Tempi di consegna: | Basato sull'inventario |

| Termini di pagamento: | T/T |

| Capacità di alimentazione: | Fornitura per progetto/batch |

|

Informazioni dettagliate |

|||

| Disponibilità: | Azione | Garanzia: | 1 anno |

|---|---|---|---|

| Condizione: | Nuovo e originale | Tecnologia: | Infiniband |

| Velocità dati: | Fino a 200 GB/s | Tipo di connettore: | QSFP56 |

| Diametro: | 3 +/- 0,2 mm | Radiu di piegatura minima: | 30 mm |

| Altezza degli occhi di uscita quasi di fascia: | 70mvpp | ESMW quasi di fascia: | 0.265UI |

Descrizione di prodotto

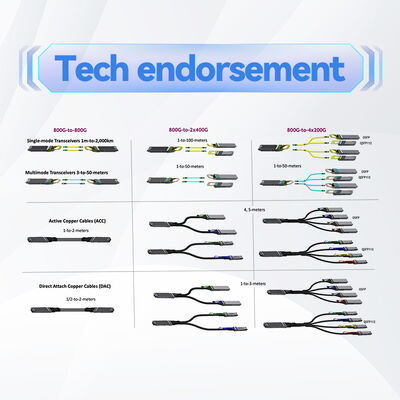

L'NVIDIA® MFS1S50-H010E è un cavo ottico attivo splitter (AOC) ad alte prestazioni che abilita la connettività da 200 Gb/s a 2x100 Gb/s nei moderni data center. Progettato per ambienti sensibili ai costi ma esigenti, questo AOC basato su VCSEL QSFP56 fornisce un'interfaccia senza interruzioni tra una porta switch da 200 Gb/s e due server o nodi di calcolo separati da 100 Gb/s. Conforme agli standard SFF-8665 e SFF-8679, la serie MFS1S50 offre un'integrità del segnale robusta, bassa latenza ed efficienza energetica superiore. La lunghezza di 10 metri (H010E) è ideale per le connessioni top-of-rack (ToR) ai server, semplificando il cablaggio pur mantenendo un'elevata larghezza di banda.

Ogni cavo splitter integra EEPROM su entrambe le estremità QSFP56 per il monitoraggio del prodotto in tempo reale e la segnalazione dello stato, pienamente compatibile con gli switch InfiniBand ed Ethernet NVIDIA. Con rigorosi test di produzione e il design di qualità unico di NVIDIA, questo AOC garantisce affidabilità plug-and-play e un ciclo di vita esteso nelle implementazioni di cluster enterprise, HPC e AI.

Consente a una porta switch da 200 Gb/s di servire due endpoint da 100 Gb/s, migliorando la densità delle porte e riducendo i costi dell'infrastruttura.

L'architettura in fibra multimodale basata su VCSEL garantisce una latenza ultra-bassa per carichi di lavoro HPC e AI sensibili alla latenza.

Monitoraggio in tempo reale: potenza ottica Tx/Rx, corrente di bias, tensione di alimentazione, temperatura del case, soglie di avviso/allarme.

Temperatura operativa del case da 0°C a 70°C, stoccaggio da -40°C a 85°C, adatta per ambienti di data center esigenti.

Equalizzazione di ingresso Tx, ampiezza di uscita Rx, pre-enfasi; controllo CDR Tx/Rx per operazioni 100GbE.

Interfaccia di gestione standard a 2 fili, ModSelL, IntL, ResetL, LPMode per il controllo completo dell'host.

L'MFS1S50-H010E utilizza array di laser a emissione verticale a cavità (VCSEL) e fotodiodi PIN ad alta sensibilità su quattro coppie di fibre multimodali. Sul lato QSFP56 da 200 Gb/s, tutte e quattro le linee operano a 50 Gb/s PAM4 (53,125 GBd) per ottenere una larghezza di banda aggregata di 200 Gb/s; le estremità di breakout gestiscono ciascuna due linee a 100 Gb/s (50 Gb/s PAM4 per linea). Questo design ottico attivo elimina il degrado del segnale in rame ed estende la portata fino a 50 metri mantenendo tassi di errore di bit inferiori a 1e-12.

Il cavo dispone di segnali di controllo conformi a SFF-8636, inclusi selezione modulo, modalità a basso consumo e linea di interruzione. Il monitoraggio diagnostico digitale (DDM) on-chip fornisce informazioni in tempo reale sullo stato del collegamento, semplificando la gestione della rete e la risoluzione dei problemi. Inoltre, il ricetrasmettitore supporta la selezione della velocità per velocità di linea flessibili: 10,3125 G NRZ, 25,78125 G NRZ e 26,5625 G PAM4 per garantire la compatibilità con le versioni precedenti, se necessario.

- Connettività da switch Top-of-Rack (ToR) a server doppio in fabric 200GbE o InfiniBand HDR.

- Cluster di High-Performance Computing (HPC) che richiedono bassa latenza e cablaggio ad alta densità.

- Infrastruttura di training AI/ML con uplink da 200G a server GPU (ad es. switch NVIDIA Quantum o Spectrum).

- Architetture spine-leaf del data center in cui l'efficienza delle porte e la gestione semplificata dei cavi sono fondamentali.

- Aggregazione core enterprise che riduce il numero di ricetrasmettitori aumentando la larghezza di banda per unità rack.

Progettato per switch InfiniBand NVIDIA Quantum (ad es. serie QM8700, QM9700) e switch Ethernet NVIDIA Spectrum. L'MFS1S50-H010E è anche interoperabile con qualsiasi porta QSFP56 standard che supporti l'addestramento del collegamento compatibile con 200GbE o InfiniBand HDR/NDR. L'EEPROM dell'AOC fornisce un'identificazione univoca del prodotto, rendendolo completamente gestito dalle piattaforme di rete NVIDIA. Per host non NVIDIA, il cavo è conforme allo standard QSFP56 MSA (SFF-8665) e l'interfaccia elettrica segue lo standard SFF-8679. Confermare sempre la configurazione della porta host per il supporto del breakout.

| Piattaforma / Famiglia di prodotti | Velocità supportata | Tipo di porta |

|---|---|---|

| Switch InfiniBand NVIDIA Quantum HDR (QM8700, QM8790) | 200G HDR | QSFP56 |

| Switch Ethernet NVIDIA Spectrum-2/3 (SN3700, SN4600) | 200GbE | QSFP56 |

| NVIDIA ConnectX-6 HDR / ConnectX-6 Dx | 100 Gb/s per coda | QSFP56 |

| Switch 200GbE di terze parti con supporto breakout | 200G → 2x100G | QSFP56 compatibile |

| Parametro | Dettagli |

|---|---|

| Modello prodotto | NVIDIA AOC, 200G a 2x100G, QSFP56 a 2xQSFP56 |

| Formato | Cavo splitter ottico attivo QSFP56 a 2x QSFP56 |

| Velocità dati | 200 Gb/s (estremità principale) / 100 Gb/s per ramo breakout |

| Velocità di segnalazione per linea | 53,125 GBd PAM4 (nominale) |

| Lunghezza cavo | 10 metri (tolleranza: +300 mm / -0 per lunghezze <50 m)Tipo di fibra |

| Fibra multimodale (MMF) 50/125 µm, guaina Aqua | Raggio di curvatura minimo |

| 30 mm | Tensione di alimentazione (Vcc) |

| 3,135 V – 3,465 V (Tip. 3,3 V) | Consumo energetico (estremità 200G) |

| Tip. 4,5 W, Max 5,0 W | Consumo energetico (estremità 100G per ramo) |

| Tip. 3,0 W, Max 3,5 W | Temperatura operativa del case |

| 0°C a 70°C | Temperatura di stoccaggio |

| -40°C a 85°C | Umidità relativa (senza condensa) |

| 5% a 85% | Tolleranza ESD |

| Conforme alla tipica gestione ESD dei data center; sicurezza laser di classe I | Funzionalità diagnostiche |

| DDM (potenza Tx/Rx, bias, tensione, temperatura), LOS/LOL, guasto Tx, equalizzazione programmabile | Conformità normativa |

| CE, FCC Classe A, ICES, RCM, VCCI, CB, cTUVus, RoHS (secondo gli standard NVIDIA) | Guida alla selezione e informazioni sull'ordine |

| Descrizione | Lunghezza | MFS1S50-H003V |

|---|---|---|

| NVIDIA AOC, 200G a 2x100G, QSFP56 a 2xQSFP56 | 30 metri | MFS1S50-H005V |

| NVIDIA AOC, 200G a 2x100G, QSFP56 a 2xQSFP56 | 30 metri | MFS1S50-H010E |

| NVIDIA AOC, 200G a 2x100G, QSFP56 a 2xQSFP56 | 30 metri | MFS1S50-H015V |

| NVIDIA AOC, 200G a 2x100G, QSFP56 a 2xQSFP56 | 30 metri | MFS1S50-H020V |

| NVIDIA AOC, 200G a 2x100G, QSFP56 a 2xQSFP56 | 30 metri | MFS1S50-H030V |

| NVIDIA AOC, 200G a 2x100G, QSFP56 a 2xQSFP56 | 30 metri | Per lunghezze personalizzate o requisiti di grandi volumi, si prega di contattare il nostro team di vendita. Il suffisso "E" indica codici specifici regionali o di fabbrica; le prestazioni elettriche e ottiche sono identiche alla serie standard H0xxV. |

Perché scegliere Starsurge per le soluzioni NVIDIA AOC

- Cavi NVIDIA autentici al 100%, completamente tracciabili e supportati dalla qualità del produttore.Competenza tecnica:

- I nostri ingegneri forniscono convalida della compatibilità pre-vendita e supporto post-vendita.Logistica globale:

- Spedizione rapida in tutto il mondo con imballaggio antistatico appropriato e protezione ESD.Prezzi competitivi e sconti sui volumi:

- Ideale per buildout di data center e progetti di aggiornamento dell'infrastruttura.Opzioni di garanzia estesa:

- Garanzia standard di 1 anno con copertura estesa disponibile su richiesta.Servizio e supporto

Checklist dell'acquirente

- Verificare la lunghezza del cavo richiesta e i vincoli del raggio di curvatura nel layout del rack.

- Assicurarsi che entrambi i sistemi host alle estremità 100G dispongano di alloggiamenti QSFP56 con un flusso d'aria e un budget energetico adeguati.

- Verificare se l'ambiente richiede certificazioni normative aggiuntive (ad es. China RoHS).

- Considerare l'ordine di unità di riserva per una simmetria del collegamento identica in cluster ad alta disponibilità.

- Domande frequenti (FAQ)

- Non superare la tensione di alimentazione massima assoluta (3,6 V) o la tensione di ingresso dati per evitare danni irreversibili.

- Evitare piegature strette al di sotto di un raggio di 30 mm per mantenere le prestazioni ottiche e prevenire la rottura della fibra.

- Inserire sempre i moduli QSFP delicatamente negli alloggiamenti; l'inserimento forzato può danneggiare i connettori o le chiusure dell'alloggiamento.

- Operare nell'intervallo di temperatura del case 0–70°C; garantire un flusso d'aria adeguato in ambienti ad alta densità.

- In caso di danni visibili allo stivale splitter o alla guaina, sostituire il cavo per evitare problemi di integrità del segnale.

- Prodotti correlati

- – Cavo ottico attivo da 200G a 200G QSFP56 (punto-punto)NVIDIA MCP1650-HxxxE

- – AOC splitter QSFP28 da 100GbE a 2x50GbE SFP56Switch NVIDIA Quantum HDR QM8700

- – Switch InfiniBand da 40 porte a 200 Gb/sScheda adattatore NVIDIA ConnectX-6 Dx

- – Scheda adattatore Ethernet/IB QSFP56 dual-port da 100 Gb/sGuide e risorse correlate

- Linee guida e FAQ sulla gestione dei cavi NVIDIA (MLNX-15-3603)

- SFF-8636 Rev 2.9 – Interfaccia di gestione per moduli QSFP

- Best Practice per l'implementazione di cavi breakout 200G nei data center

- Informazioni su Hong Kong Starsurge Group