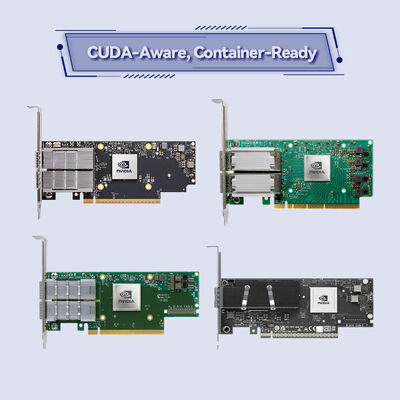

NVIDIA ConnectX-7 VPI Adapter Dual-Port NDR 400Gb/s, PCIe 5.0, GPUDirect, RoCE ¢ MCX75310AAS-NEAT

Dettagli:

| Marca: | Mellanox |

| Numero di modello: | MCX75310AAS-NEAT (900-9x766-003N-SQ0) |

| Documento: | Connectx-7 infiniband.pdf |

Termini di pagamento e spedizione:

| Quantità di ordine minimo: | 1 pz |

|---|---|

| Prezzo: | Negotiate |

| Imballaggi particolari: | Scatola esterna |

| Tempi di consegna: | Basato sull'inventario |

| Termini di pagamento: | T/T |

| Capacità di alimentazione: | Fornitura per progetto/batch |

|

Informazioni dettagliate |

|||

| Modello n.: | MCX75310AAS-NEAT (900-9x766-003N-SQ0) | Porti: | Porta singola |

|---|---|---|---|

| Tecnologia: | Infiniband | Tipo di interfaccia: | OSFP56 |

| Specifica: | 16,7 cm x 6,9 cm | Origine: | India / Israele / Cina |

| velocità di trasmissione: | 400GBE | Interfaccia host: | Gen3 x16 |

| Evidenziare: | Adaptatore di rete NVIDIA ConnectX-7,Carte PCIe NDR a doppia porta 400 Gb/s,Mellanox RoCE GPUDirect adattatore |

||

Descrizione di prodotto

MCX755106AS‑HEAT | NIC Smart PCIe 5.0 Dual-Port

Accelera i carichi di lavoro AI, di calcolo scientifico e cloud aziendali con la famiglia NVIDIA ConnectX-7. L'MCX755106AS-HEAT offre fino a200 Gb/s InfiniBand (HDR)e flessibilità Ethernet 200 GbE, motori di calcolo in rete, sicurezza a livello hardware e latenza ultra-bassa — tutto alimentato da PCIe 5.0.

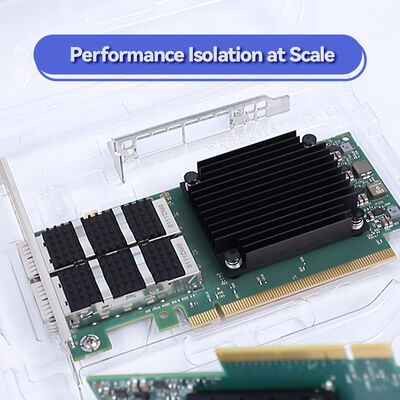

L'adattatore NVIDIA ConnectX-7 VPI MCX755106AS-HEAT è una scheda di interfaccia di rete intelligente dual-port da 200 Gb/s progettata per cluster di High-Performance Computing (HPC), fabbriche AI e data center aziendali. Combinando il supporto per i protocolli InfiniBand ed Ethernet, abilita il Remote Direct Memory Access (RDMA), GPUDirect Storage e motori di calcolo avanzati in rete come SHARPv3 e il disconoscimento del rendezvous. Con interfaccia host PCIe 5.0 e acceleratori di sicurezza basati su hardware, questo adattatore scarica la CPU, riduce il TCO e offre prestazioni costanti a bassa latenza.

Ideale per le organizzazioni che modernizzano la propria infrastruttura IT dall'edge al core, la famiglia ConnectX-7 offre networking, storage e sicurezza definiti dal software e accelerati dall'hardware, abilitando soluzioni scalabili e sicure con un overhead minimo.

ConnectX-7 integra la tecnologia NVIDIA ASAP² (Accelerated Switch and Packet Processing) per fornire networking definito dal software a velocità di linea senza consumare core della CPU. I motori hardware inline gestiscono la crittografia/decrittografia per IPsec, TLS e MACsec, proteggendo i dati in transito dall'edge al core. Per lo storage, il disconoscimento NVMe-oF integrato e GPUDirect Storage consentono il movimento diretto dei dati tra la memoria di storage e la GPU, riducendo la latenza e massimizzando il throughput. L'adattatore supporta anche la sincronizzazione temporale avanzata (PTP con precisione di 12 ns) e il paging su richiesta (ODP) per RDMA senza registrazione, rendendolo ideale per architetture disaggregate e incentrate sulla memoria.

- Cluster AI e Large Language Model (LLM): Interconnessione ad alta velocità per server GPU, sfruttando GPUDirect RDMA e i disconoscimenti collettivi SHARP.

- High-Performance Computing (HPC): Fabric InfiniBand HDR da 200 Gb/s per MPI, OpenSHMEM e simulazioni scientifiche.

- Cloud Hyperscale e Data Center SDN: RoCEv2, accelerazione overlay e SR-IOV per la virtualizzazione multi-tenant.

- Gateway di Sicurezza Aziendale: Crittografia MACsec/IPsec inline per comunicazioni edge-to-core con disconoscimento hardware.

- Sistemi di Storage: Disconoscimento NVMe-oF/TCP, piattaforme di storage distribuite che richiedono latenza ultra-bassa e IOPS elevati.

✅ Sistemi Operativi: Driver in-box per Linux (RHEL, Ubuntu), Windows Server, VMware ESXi (SR-IOV), Kubernetes (plugin CNI).

✅ Protocolli: InfiniBand (HDR/EDR), Ethernet (200 GbE a 10 GbE), RoCE, RoCEv2, iSCSI, NVMe-oF, SRP, iSER, NFS su RDMA, SMB Direct.

✅ Middleware HPC: NVIDIA HPC-X, UCX, UCC, NCCL, OpenMPI, MVAPICH, MPICH, OpenSHMEM.

✅ Gestione: NC-SI, MCTP su PCIe/SMBus, PLDM, Redfish, SPDM, aggiornamento firmware sicuro.

| Specifica | Dettagli |

|---|---|

| Modello Prodotto | MCX755106AS-HEAT (NVIDIA ConnectX-7 VPI) |

| Velocità Massima | InfiniBand HDR 200 Gb/s; Ethernet fino a 200 GbE |

| Configurazione Porte | Dual-port (supporta varianti a 1/2 porta, questo modello dual-port QSFP56) |

| Interfaccia Host | PCIe 5.0 x16 (fino a x32 linee con biforcazione / Multi-Host) |

| Form Factor | PCIe HHHL (Half Height Half Length) – staffa standard |

| Supporto Protocollo | InfiniBand (HDR/EDR) e Ethernet (200 GbE/100 GbE/50 GbE/25 GbE/10 GbE) |

| RDMA | RoCE, RoCEv2, trasporto affidabile hardware, DCT, XRC, Paging su Richiesta (ODP) |

| Disconoscimento Sicurezza | IPsec/TLS/MACsec Inline (AES-GCM a 128/256 bit), Avvio Sicuro, Crittografia Flash, Attestazione Dispositivo |

| Disconoscimento Storage | NVMe-oF (TCP/Fabrics), NVMe/TCP, T10-DIF, XTS-AES a 256/512 bit a livello di blocco |

| Timing e Sincronizzazione | IEEE 1588v2 (PTP), precisione di 12 ns, SyncE (G.8262.1), PPS configurabile, pianificazione basata su tempo |

| Virtualizzazione | SR-IOV, accelerazione VirtIO, disconoscimento overlay (VXLAN, GENEVE, NVGRE) |

| Funzionalità Avanzate | GPUDirect RDMA, GPUDirect Storage, disconoscimento SHARP, Routing Adattivo, Disconoscimento Burst Buffer |

| Gestione e Avvio | UEFI, PXE, avvio iSCSI, avvio remoto InfiniBand, PLDM, Redfish, SPDM, MCTP |

*Le specifiche si basano sulla documentazione pubblica NVIDIA. Verificare la configurazione esatta per il proprio sistema prima dell'ordine.

| Modello | Porte / Velocità | Interfaccia Host | Target Chiave |

|---|---|---|---|

| MCX755106AS-HEAT | 2 porte HDR InfiniBand da 200 Gb/s / 200 GbE | PCIe 5.0 x16 | Cluster AI, HPC, data center aziendali |

| MCX75310AAS-NEAT | 2 porte NDR InfiniBand da 400 Gb/s | PCIe 5.0 x16 | AI di fascia alta, HPC su larga scala |

| Varianti OCP 3.0 | SFF / TSF con HDR/NDR | PCIe Gen5 | Server Open Compute Project |

- Latenza ultra-bassa e throughput elevato: RDMA hardware e calcolo in rete riducono al minimo la latenza di coda delle applicazioni.

- Fabric unificato: Un adattatore supporta sia InfiniBand che Ethernet, semplificando l'inventario e la distribuzione.

- PCIe 5.0 a prova di futuro: 32 GT/s per linea, larghezza di banda doppia rispetto a PCIe 4.0, eliminando i colli di bottiglia I/O.

- TCO ridotto: Scarica la CPU da attività di networking, storage e sicurezza, consentendo un utilizzo del server più efficiente.

- Ottimizzato per AI: GPUDirect nativo e operazioni collettive SHARPv3 accelerano l'addestramento e l'inferenza dei modelli.

Hong Kong Starsurge Group Co., Limited fornisce supporto end-to-end, inclusa consulenza pre-vendita, configurazione firmware personalizzata e spedizione in tutto il mondo. Tutti gli adattatori ConnectX-7 sono coperti da una garanzia di 1 anno (estensibile) e assistenza tecnica da parte di ingegneri di rete esperti. Offriamo supporto multilingue, servizi RMA e logistica di sostituzione rapida per ridurre al minimo i tempi di inattività.

- Assicurarsi che lo slot PCIe fornisca alimentazione sufficiente (75W tramite slot, nessuna alimentazione ausiliaria richiesta per il funzionamento standard).

- Verificare lo spazio fisico: il fattore di forma HHHL si adatta alla maggior parte dei server 1U/2U; le varianti OCP richiedono uno slot mezzanine corrispondente.

- Per la distribuzione RoCE, configurare DCB (Priority Flow Control) e ECN sugli switch per Ethernet senza perdite.

- Aggiornare sempre il firmware alla versione stabile più recente per sfruttare i miglioramenti di sicurezza e prestazioni.

Fondata nel 2008, Hong Kong Starsurge Group Co., Limited è un fornitore di hardware di rete, servizi IT e soluzioni di integrazione di sistemi guidato dalla tecnologia. Serviamo clienti in tutto il mondo con prodotti tra cui switch di rete, NIC, access point wireless, controller, cavi e apparecchiature di rete. Il nostro team di vendita e tecnico esperto supporta settori come governo, sanità, produzione, istruzione, finanza e impresa. Con un approccio incentrato sul cliente, Starsurge si concentra su qualità affidabile, servizio reattivo e soluzioni su misura, aiutando i clienti a costruire un'infrastruttura di rete efficiente, scalabile e affidabile.

Forniamo soluzioni IoT, sistemi di gestione della rete, sviluppo di software personalizzato, supporto multilingue e consegna globale. Scegli Starsurge come tuo partner di fiducia per le soluzioni di rete NVIDIA.