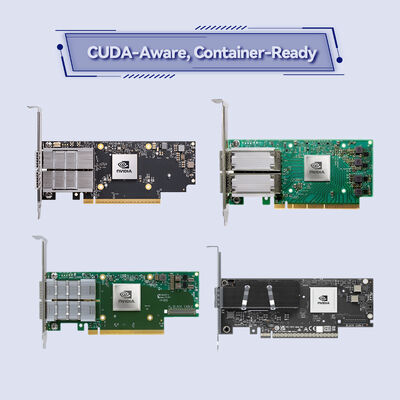

NVIDIA ConnectX-6 InfiniBand Adapter MCX653106A-ECAT 200Gb/s Smart NIC

Dettagli:

| Marca: | Mellanox |

| Numero di modello: | MCX653106A-ECAT |

| Documento: | connectx-6-infiniband.pdf |

Termini di pagamento e spedizione:

| Quantità di ordine minimo: | 1 pz |

|---|---|

| Prezzo: | Negotiate |

| Imballaggi particolari: | Scatola esterna |

| Tempi di consegna: | Basato sull'inventario |

| Termini di pagamento: | T/T |

| Capacità di alimentazione: | Fornitura per progetto/batch |

|

Informazioni dettagliate |

|||

| Stato dei prodotti: | Azione | Applicazione: | Server |

|---|---|---|---|

| Tipo di interfaccia:: | Infiniband | Porti: | Doppio |

| Velocità massima: | 100 gbe | Tipo: | Cablato |

| Condizione: | Nuovo e originale | Tempo di garanzia: | 1 anno |

| Modello: | MCX653106A-ECAT | Nome: | Cartella di rete Mellanox MCX653106A-ECAT originale connettere X-6 100Gb/s doppia porta QSFP56 Ether |

| Parola chiave: | scheda di rete Mellanox | ||

| Evidenziare: | NVIDIA ConnectX-6 adattatore Infiniband,200 Gb/s Smart NIC,Scheda di rete Mellanox con garanzia |

||

Descrizione di prodotto

Adapter intelligente a doppia porta da 200 Gb/s con elaborazione in rete

Il NVIDIA ConnectX-6 MCX653106A-ECAT offre fino a200 Gb/scon banda larga, latenza sub-microsegonda e hardware offload per HPC, AI e storage iperconvergente.0, questo adattatore QSFP56 InfiniBand a doppia porta massimizza l'efficienza e la scalabilità del data center.

IlMCX653106A-ECATfa parte della famiglia di adattatori NVIDIA ConnectX-6 InfiniBand, progettati per i carichi di lavoro più esigenti. Combina due porte QSFP56 capaci di connettività InfiniBand o Ethernet a 200 Gb/s,offrire un trasporto affidabile basato su hardware, controllo della congestione, e motori di network computing.l'adattatore riduce i costi generali della CPU e aumenta le prestazioni delle applicazioni in cluster su larga scalaImprese, laboratori di ricerca e data center di iper-scala si affidano a ConnectX-6 per costruire tessuti ad alta efficienza energetica e a bassa latenza.

Fino a 200 Gb/s per porta (HDR InfiniBand / 200 GbE)

Fino a 215 milioni di messaggi/sec

XTS-AES a livello di blocco a 256/512 bit, conforme a FIPS

Discarichi collettivi, NVMe-oF target/initiator discarichi

PCIe Gen 4.0/3.0 x16 (supporto a doppia porta)

SR-IOV fino a 1K VF, ASAP2, Open vSwitch offload

RoCE, XRC, DCT, Paging on-demand, supporto al routing adattivo

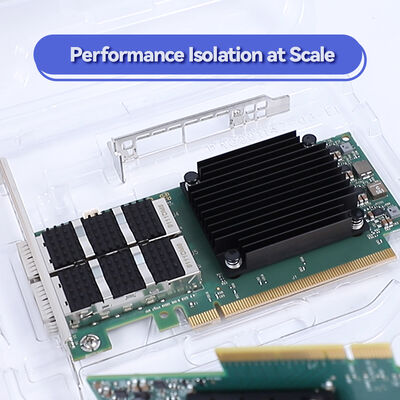

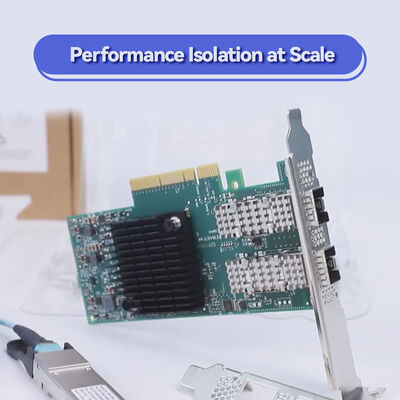

PCIe stand-up (basso profilo), doppia porta QSFP56

Basato sull'architettura InfiniBand di NVIDIA, ConnectX-6 integraInformatica in reteL'adattatore supporta anche sistemi per l'accelerazione delle operazioni MPI, dei framework di deep learning e dei protocolli di archiviazione.Accesso remoto diretto alla memoria (RDMA)Il controllo della congestione basato su hardware garantisce prestazioni prevedibili anche sotto carico elevato.NVIDIA GPUDirect RDMAPermette lo scambio diretto di dati tra la memoria GPU e l'adattatore di rete, riducendo la latenza per l'addestramento dell'IA.NVMe su tessuti (NVMe-oF)La scheda riduce l'utilizzo della CPU nelle matrici di archiviazione, consentendo al contempo un accesso ad alto throughput e a bassa latenza al flash NVMe.

- Calcolo ad alte prestazioni (HPC):Simulazioni su larga scala, modellazione del tempo e dinamica dei fluidi computazionali che richiedono bassa latenza e ampiezza di banda.

- Cluster di AI e Machine Learning:Formazione distribuita di reti neurali profonde, sfruttando GPUDirect e RDMA per la massima efficienza.

- Sistemi di stoccaggio NVMe-oF:I carichi di destinazione o di inizio consentono lo storage disaggregato ad alte prestazioni con bassi costi generali di CPU.

- Centri di dati a iperescala:Ambienti virtualizzati con SR-IOV, reti di sovrapposizione e catena di servizi.

- Servizi finanziari:Infrastrutture di trading a latenza ultra bassa che richiedono prestazioni deterministiche.

Il ConnectX-6 MCX653106A-ECAT è compatibile con una vasta gamma di server, switch e sistemi operativi.con una capacità di accensione superiore a 50 WL'adattatore supporta le slot PCIe standard (x16, x8, x4) e include il supporto dei driver per le principali piattaforme OS.

| Parametro | Specificità |

|---|---|

| Modello di prodotto | MCX653106A-ECAT |

| Tasso di dati | 200Gb/s, 100Gb/s, 50Gb/s, 40Gb/s, 25Gb/s, 10Gb/s, 1Gb/s (InfiniBand e Ethernet) |

| Portos | 2x connettori QSFP56 |

| Interfaccia dell'host | PCIe Gen 4.0 / 3.0 x16 (supporta configurazioni x8, x4, x2, x1) |

| Latenza | Un'intensità di calore inferiore o uguale a 0,8 μs |

| Tasso dei messaggi | Fino a 215 milioni di messaggi/sec |

| Crittografia | XTS-AES 256/512-bit, conformità FIPS 140-2 pronta |

| Fattore di forma | PCIe stand-up a basso profilo (montato con supporto alto, supporto corto incluso) |

| Dimensioni (senza parentesi) | 167.65 mm x 68.90 mm |

| Consumo di energia | Tipico 22W (a seconda del traffico) |

| Virtualizzazione | SR-IOV (1K VF), VMware NetQueue, NPAR, ASAP2 flow offload |

| Gestione | NC-SI, MCTP su PCIe/SMBus, PLDM per l'aggiornamento e il monitoraggio del firmware |

| Avvio remoto | InfiniBand, iSCSI, PXE, UEFI |

| Sistemi operativi | RHEL, SLES, Ubuntu, Windows Server, FreeBSD, VMware vSphere, OFED stack |

| Numero della parte da ordinare (OPN) | Portos | Velocità massima | Interfaccia dell'host | Principale differenziatore |

|---|---|---|---|---|

| MCX653106A-ECAT | 2x QSFP56 | 100Gb/s (anche inferiore) | PCIe 3.0/4.0 x16 | Dual-port 100GbE/IB, offloads avanzati, criptovaluta opzionale? nessuna criptovaluta integrata in questa variante, ma supporta la crittografia di blocchi tramite software?ideale per la virtualizzazione e lo storage |

| MCX653105A-HDAT | 1x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | 200Gb/s a porta singola, supporto criptografico |

| MCX653106A-HDAT | 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Doppia porta 200Gb/s con larghezza di banda completa, crittografia di scarico |

| MCX653105A-ECAT | 1x QSFP56 | 100 Gb/s | PCIe x16 | 100Gb/s a porta singola, accesso a basso costo |

| MCX653436A-HDAT (OCP 3.0) | 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 piccolo fattore di forma, doppia porta |

- Performance delle applicazioni massimizzata:I discarichi hardware per MPI, NVMe-oF e crittografia liberano i core della CPU per i carichi di lavoro effettivi.

- Larghezza di banda pronta per il futuro:La disponibilità PCIe 4.0 e 200 Gb/s garantisce la longevità dei tessuti ad alta velocità.

- Memoria e calcolo in rete:Supporta scarichi collettivi e burst buffer, riducendo i costi di movimento dei dati.

- Sicurezza affidabile:La crittografia AES-XTS a livello di blocco con conformità FIPS garantisce la protezione dei dati in stato di riposo e in transito senza colpi di performance.

- Gestione semplificata:Ampio supporto per il sistema operativo e l'ipervisor, con driver stack unificato (OFED, WinOF-2).

Hong Kong Starsurge Group fornisce supporto tecnico completo, copertura di garanzia e servizi RMA per tutti gli adattatori NVIDIA ConnectX.aggiornamenti del firmwareOffriamo spedizioni globali, prezzi all'ingrosso per progetti di data center e prenotazioni di magazzino personalizzate.contattare il nostro team di vendita per ricevere preventivi personalizzati e dettagli del tempo di consegna.

• Verificare che lo slot PCIe fornisca una potenza adeguata (fino a 75W tramite slot; questo adattatore utilizza in genere < 25W).

• Per le piattaforme raffreddate a liquido, verificare la compatibilità con Intel Server System D50TNP se è necessaria una variante della piastra fredda (questa OPN è raffreddata a aria standard).

• Verificare la compatibilità dei driver del sistema operativo con gli ultimi stack OFED o WinOF-2.

Dal 2008, Hong Kong Starsurge Group Co., Limited fornisce hardware di rete di livello aziendale, integrazione di sistemi e servizi IT in tutto il mondo.Starsurge offre soluzioni certificate per il governoIl nostro team tecnico garantisce una implementazione fluida, dalla progettazione dell'architettura pre-vendita al supporto post-vendita.,Forniamo componenti infrastrutturali su misura e scalabili, inclusi NIC, switch, cavi e soluzioni di rete end-to-end.

Consegna globale · Supporto multilingue · Servizi OEM disponibili

| Componente / Ecosistema | Sostenuto | Altre note |

|---|---|---|

| NVIDIA Quantum HDR Switch | ✓ Sì | 200 Gb/s integrazione completa del tessuto |

| Switch Ethernet 200G/100G | ✓ Sì | Richiede modalità di ricevitore/FEC compatibili |

| GPU Direct RDMA | ✓ Sì | Supporto per serie di GPU NVIDIA |

| VMware vSphere / ESXi | ✓ Certificato | Guidatori nativi, supporto SR-IOV |

| Windows Server 2019/2022 | ✓ Sì | Pacchetto driver WinOF-2 |

| Linux Kernel e OFED | ✓ Supporto completo | MLNX_OFED, driver della casella di posta |

- Confirmare la velocità di collegamento richiesta: 100Gb/s dual-port soddisfa il piano di larghezza di banda del cluster?

- Verificare lo slot PCIe del server: x16 fisico, Gen 3 o Gen 4 raccomandato.

- Controllare il tipo di cavo: QSFP56 in rame passivo (fino a 5 m) o cavi ottici attivi per una portata più lunga.

- Assicurarsi che i driver del sistema operativo siano disponibili (OFED, WinOF).

- Per i requisiti di crittografia: confermare se è necessaria la crittografia a blocchi integrata MCX653106A-ECAT supporta AES-XTS, ma conferma sempre il livello FIPS con la scheda dati NVIDIA.

- Valutare le esigenze di virtualizzazione: SR-IOV, VXLAN offload, ecc.