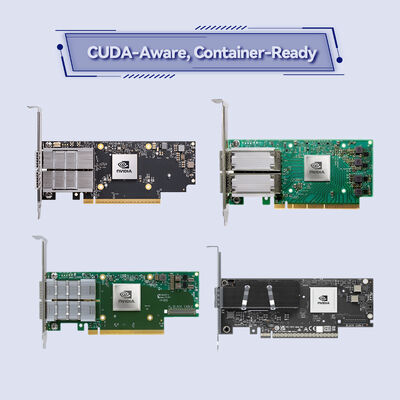

Scheda di rete InfiniBand NVIDIA MCX555A-ECAT 100Gb/s a porta singola QSFP28 PCIe 3.0 x16 ConnectX-5

Dettagli:

| Marca: | Mellanox |

| Numero di modello: | MCX555A-ECAT |

| Documento: | CONNECTX-5 infiniband.pdf |

Termini di pagamento e spedizione:

| Quantità di ordine minimo: | 1 pz |

|---|---|

| Prezzo: | Negotiate |

| Imballaggi particolari: | Scatola esterna |

| Tempi di consegna: | Basato sull'inventario |

| Termini di pagamento: | T/T |

| Capacità di alimentazione: | Fornitura per progetto/batch |

|

Informazioni dettagliate |

|||

| Stato dei prodotti: | Azione | Applicazione: | Server |

|---|---|---|---|

| Condizione: | Nuovo e originale | Tipo: | Cablato |

| Velocità massima: | EDR e 100GBE | Connettore Ethernet: | QSFP28 |

| Evidenziare: | Scheda InfiniBand NVIDIA ConnectX-5,Scheda di rete QSFP28 100Gb/s,Scheda Mellanox PCIe 3.0 x16 |

||

Descrizione di prodotto

Adapter di rete ad alte prestazioni a bassa latenza 100Gb/s progettato per data center HPC, AI e cloud.e tag matching per i carichi di lavoro MPI, fornendo un throughput e un'efficienza della CPU leader nel settore.

IlNVIDIA ConnectX-5 MCX555A-ECATè una scheda di adattatore InfiniBand a singola porta da 100 Gb/s in un fattore di forma PCIe di basso profilo.Trasmissione di 100 Gb/sLa scheda supporta sia InfiniBand (fino a EDR) che 100GbE, fornendo una connettività versatile per il calcolo ad alte prestazioni, lo storage,e ambienti virtualizzati.

Costruito con un switch PCIe incorporato e funzionalità RDMA avanzate, l'MCX555A-ECAT offloads compiti critici di comunicazione dalla CPU minore consumo energeticoÈ pienamente compatibile con gli slot PCIe 3.0 x16 e supporta una vasta gamma di sistemi operativi e framework di accelerazione.

- Fino a 100 Gb/sconnettività per porta (InfiniBand EDR / 100GbE)

- Connettore QSFP28 singoloper cavi ottici o di rame

- Interfaccia host PCIe 3.0 x16(autonegozia a x8, x4, x2, x1)

- RDMA, semantica di invio/ricezionecon trasporto affidabile basato su hardware

- Identificazione dei marchi e ritrovo degli scarichiper MPI e SHMEM

- NVMe su tessuti (NVMe-oF)per una conservazione efficiente

- GPUDirect RDMA (PeerDirect)accelerazione per la comunicazione GPU

- Controllo della congestione basato su hardware e supporto per l'adattamento del routing

- Virtualizzazione SR-IOV:fino a 512 funzioni virtuali

- RoHS, fattore di forma a basso profilo(compresa la parentesi di altezza)

L'architettura ConnectX-5 integra una serie di motori di accelerazione hardware che riducono l'intervento della CPU e migliorano la scalabilità delle applicazioni:

- MPI Tag Matching & Rendezvous Offload:Offloads messaggi di abbinamento e rendezvous protocol processing, migliorando notevolmente le prestazioni MPI per HPC cluster.

- RDMA fuori ordine con routing adattivo:Consente l'uso efficiente di più percorsi di rete mantenendo la semantica di completamento ordinato, massimizzando l'utilizzo del tessuto.

- NVMe-oF Target Offloads:Permette ai sistemi di archiviazione NVMe di servire l'accesso remoto con overhead CPU quasi zero, ideale per architetture di archiviazione disaggregate.

- Trasporti dinamicamente connessi (DCT):Fornisce una scalabilità estrema per i grandi sistemi di calcolo e di archiviazione eliminando i costi di installazione della connessione.

- ASAP2 Accelerated Switching & Packet Processing:Discarico dell'hardware per Open vSwitch (OVS) e tunneling di rete sovrapposta (VXLAN, NVGRE, GENEVA).

- Paging su richiesta (ODP):Supporta la paginazione della memoria virtuale per le operazioni RDMA, semplificando lo sviluppo delle applicazioni.

- "Licenza" di calcolatori di alte prestazioni (HPC):Ideale per cluster di supercalcolo, simulazioni basate su MPI e carichi di lavoro di ricerca scientifica che richiedono bassa latenza e alte velocità di messaggio.

- AI & Deep Learning Training:In combinazione con GPUDirect RDMA, consente una comunicazione rapida GPU-GPU tra i nodi, accelerando i tempi di addestramento.

- Sistemi di stoccaggio NVMe-oF:Impiegare come obiettivi di archiviazione o iniziatori in NVMe su ambienti Fabrics per un accesso allo storage a blocchi ad alto throughput e a bassa latenza.

- Centri dati cloud e virtualizzati:SR-IOV e gli offload di virtualizzazione supportano ambienti multi-tenant con QoS garantito e isolamento sicuro.

- Negoziazione ad alta frequenza (HFT):La latenza ultra-bassa e il timestamping hardware (IEEE 1588v2) soddisfano le esigenze delle applicazioni di servizi finanziari.

L'MCX555A-ECAT è progettato per una ampia compatibilità con gli switch NVIDIA InfiniBand (ad esempio, Quantum, Spectrum) e gli switch 100GbE di terze parti.Supporta sia DAC in rame passivo che cavi ottici attivi tramite porte QSFP28.

Sistemi operativi e software:

- RHEL / CentOS, Ubuntu, Windows Server, FreeBSD, VMware ESXi

- OpenFabrics Enterprise Distribution (OFED) / WinOF-2

- NVIDIA HPC-X, OpenMPI, MVAPICH2, Intel MPI, MPI per piattaforme

- Data Plane Development Kit (DPDK) per il bypass del kernel

| Parametro | Specificità |

|---|---|

| Modello | MCX555A-ECAT |

| Fattore di forma | PCIe a basso profilo (14,2 cm x 6,9 cm senza supporto), supporto alto preinstallato, supporto corto incluso |

| Velocità e tipo di porta | 1x QSFP28, fino a 100 Gb/s InfiniBand (EDR) e 100 GbE |

| Interfaccia dell'host | PCI Express 3.0 x16 (compatibile con x8, x4, x2, x1) |

| Supporto InfiniBand | Compatibile con IBTA 1.3, 100Gb/s EDR, FDR, QDR, DDR, SDR; 8 corsie virtuali + VL15; 16 milioni di canali I/O |

| Supporto Ethernet | 100 GbE, 50 GbE, 40 GbE, 25 GbE, 10 GbE, 1 GbE; IEEE 802.3cd, 802.3bj, 802.3by, 802.3ba, 802.3ae |

| Capacità RDMA | RDMA su Ethernet convergente (RoCE), trasporto affidabile hardware, RDMA fuori ordine, operazioni atomiche |

| Discariche di stoccaggio | NVMe over Fabrics target offload, iSER, SRP, NFS RDMA, SMB Direct, trasferimento della firma T10 DIF |

| Virtualizzazione | SR-IOV (fino a 512 funzioni virtuali), VMware NetQueue, NPAR, PCIe Access Control Services (ACS) |

| Sgomberamento della CPU | TCP/UDP/IP offload senza stato, LSO/LRO, checksum offload, RSS/TSS, inserimento/ripulitura dei tag VLAN/MPLS |

| Reti sovrapposte | Discarico dell'hardware per l'incapsulamento/decapsulamento VXLAN, NVGRE, GENEVA |

| Gestione | NC-SI su MCTP, PLDM per monitor/controllo e aggiornamento del firmware, I2C, SPI, JTAG |

| Avvio remoto | Avvio remoto su InfiniBand, Ethernet, iSCSI; supporto UEFI, PXE |

| Consumo di energia | Non specificato pubblicamente; intervallo tipico inferiore ai 20 W |

| Temperatura di funzionamento | 0°C a 55°C (ambiente tipico) |

| Rispetto | RoHS, REACH, FCC, CE, VCCI, ICES, RCM |

Nota: Le specifiche derivano dalla documentazione del prodotto NVIDIA ConnectX-5. Per gli ultimi dettagli e il supporto del firmware, si rimanda alle note ufficiali di rilascio NVIDIA.

| Numero della parte d'ordine | Porti / Velocità | Interfaccia dell'host | Fattore di forma | Caratteristiche chiave |

|---|---|---|---|---|

| MCX555A-ECAT | 1x QSFP28, 100 Gb/s | PCIe 3.0 x16 | PCIe a basso profilo | Portone unico standard, EDR InfiniBand / 100GbE |

| MCX556A-ECAT | 2x QSFP28, 100 Gb/s | PCIe 3.0 x16 | PCIe a basso profilo | Doppia porta, EDR/100GbE |

| MCX556A-EDAT | 2x QSFP28, 100 Gb/s | PCIe 4.0 x16 | PCIe a basso profilo | ConnectX-5 Ex, PCIe Gen4 potenziato |

| MCX556M-ECAT-S25 | 2x QSFP28, 100 Gb/s | 2x PCIe 3.0 x8 | Socket Direct | Connessione server a doppia presa tramite imbracatura |

| MCX545B-ECAN | 1x QSFP28, 100 Gb/s | PCIe 3.0 x16 | OCP 2.0 tipo 1 | Fattore di forma Open Compute Project |

Per le varianti OCP o Multi-Host, si prega di contattare le vendite.

- Performance di applicazione superiore:Hardware offload per MPI, NVMe-oF e sovrapposizioni di core CPU liberi per la logica aziendale.

- Tessuto RDMA scalabile:DCT, XRC e RDMA out-of-order offrono una scalabilità lineare per migliaia di nodi.

- Accelerazione GPU pronta:GPUDirect RDMA consente l'accesso diretto alla memoria tra GPU e adattatori di rete, eliminando i colli di bottiglia della CPU nei cluster di IA.

- Impiego flessibile:Una singola porta QSFP28 semplifica il cablaggio ed è ideale per le architetture leaf-spine da 100 Gb/s.

- Protezione degli investimenti:Il supporto sia per InfiniBand che per Ethernet consente una transizione senza soluzione di continuità tra i protocolli man mano che le esigenze si evolvono.

Hong Kong Starsurge Group fornisce un supporto completo per l'intero ciclo di vita degli adattatori NVIDIA ConnectX-5, inclusa l'assistenza alla configurazione pre-vendita, la guida per l'aggiornamento del firmware e il servizio di garanzia.Il nostro team tecnico può aiutarvi:

- Verifica della compatibilità con il server e l'infrastruttura di switch

- Performance tuning per carichi di lavoro HPC o di storage

- Opzioni di supporto personalizzate e requisiti per l'imballaggio sfuso

- Servizi di elaborazione RMA e sostituzione avanzata

Contattate i nostri ingegneri di vendita per i prezzi dei volumi e le informazioni sui tempi di consegna.

Discarica elettrostatica (ESD):Mantenere l' adattatore in un imballaggio antistatico fino all' installazione.Requisiti di raffreddamento:Assicurare un adeguato flusso d'aria nel telaio del server per mantenere la temperatura di esercizio entro il range specificato.Aggiornamenti del firmware:Utilizzare gli strumenti firmware ufficiali NVIDIA (MFT) e verificare la compatibilità con il sistema operativo e la versione del driver prima di aggiornare.Cable bending:Seguire le linee guida sul raggio di curva del cavo QSFP28 per evitare il degrado del segnale.

Questo è un prodotto di classe A. In un ambiente residenziale può causare interferenze radio.

Fondata nel 2008,Hong Kong Starsurge Group Co., Limitedè un fornitore tecnologico di hardware di rete, servizi IT e soluzioni di integrazione di sistemi.controllerStarsurge combina una profonda competenza tecnica con un approccio orientato al cliente.,e aziendale, offrendo soluzioni IoT, sistemi di gestione della rete, sviluppo di software personalizzato e distribuzione globale multilingue.Starsurge aiuta i clienti a costruire efficienti, scalabile e affidabile infrastrutture di rete.

| Componente / sistema | Status di compatibilità | Altre note |

|---|---|---|

| NVIDIA Quantum InfiniBand Switch | Certificato | Compatibilità EDR, HDR quando si utilizza un firmware appropriato |

| NVIDIA Spectrum Ethernet Switches | Certificato | Sono supportate modalità 100GbE, 50GbE, 25GbE |

| Interruttori 100GbE di terze parti | Compatibile | Richiede la conformità agli standard IEEE; testato con i principali fornitori |

| server GPU (NVIDIA DGX, HGX) | Certificato con GPUDirect | Accelerazione RDMA per la comunicazione multi-GPU |

| Dispositivi di memorizzazione con NVMe-oF | Sostenuto | Il discarico del bersaglio consente un accesso efficiente al tessuto NVMe |

- Confirmare che il server dispone di uno slot PCIe 3.0 x16 (o x8) con spazio libero adeguato.

- ¢ Determinare il numero di porte: singola porta (MCX555A-ECAT) contro doppia porta (MCX556A-ECAT).

- ¢ Scegliere il tipo di cavo: DAC in rame passivo per lunghe distanze (≤ 5 m) o ottico per lunghe percorrenze.

- Verificare il supporto del sistema operativo e dei driver (OFED, Windows, VMware).

- Per i cluster GPU, assicurarsi che GPUDirect RDMA sia compatibile con il modello di GPU e la versione del driver.

- Verificare se è richiesta una staffa alta o corta per il telaio del server.

- NVIDIA MCX556A-ECAT Dual-port 100Gb/s ConnectX-5 adattatore

- NVIDIA MCX556A-EDAT ConnectX-5 Ex con supporto PCIe 4.0

- NVIDIA Quantum-2 QM9700 40 porte 800Gb/s InfiniBand Switch

- Cavi DAC passivi Mellanox QSFP28 (1m, 2m, 3m)

- NVIDIA Spectrum-4 SN5600 100GbE/400GbE switch Ethernet

- NVIDIA ConnectX-5 InfiniBand Adapter Card Manuale utente

- RDMA su Ethernet convergente (RoCE)

- GPUDirect RDMA Migliori pratiche per i cluster di IA

- NVMe su tessuti con ConnectX-5 Guida di configurazione

- Guida all'installazione e alla messa a punto di OFED