NVIDIA Quantum-2 QM9700-NS2R 64-Port 400G InfiniBand Managed Switch

Dettagli:

| Marca: | Mellanox |

| Numero di modello: | MQM9700-NS2R (920-9B210-00RN-0M2) |

| Documento: | MQM9700 series.pdf |

Termini di pagamento e spedizione:

| Quantità di ordine minimo: | 1 pz |

|---|---|

| Prezzo: | Negotiate |

| Imballaggi particolari: | Scatola esterna |

| Tempi di consegna: | Basato sull'inventario |

| Termini di pagamento: | T/T |

| Capacità di alimentazione: | Fornitura per progetto/batch |

|

Informazioni dettagliate |

|||

| Modello n.: | MQM9700-NS2R (920-9B210-00RN-0M2) | velocità di trasmissione: | 400G |

|---|---|---|---|

| Porti: | 64 | Tecnologia: | Infiniband |

| Velocità massima: | Ndr | Pacchetto di trasporto: | Imballaggio |

| Evidenziare: | NVIDIA Quantum-2 400G InfiniBand switch,Commutatore gestito InfiniBand a 64 porte,Commutatore di rete Mellanox Quantum-2 |

||

Descrizione di prodotto

NDR leader nel settore 400Gb/s per porta. 51.2 Tb/s di throughput aggregato. SHARPv3 in-network computing. Ultra-low latency per tessuti AI e HPC.

L'NVIDIA Quantum-2 QM9700-NS2R è uno switch InfiniBand a 1U completamente gestito che offre una larghezza di banda non bloccante senza precedenti di 64 porte di 400Gb/s (NDR).ricerca scientifica, e cluster di calcolo ad alte prestazioni (HPC), consente una scalabilità massiccia con un throughput bidirezionale aggregato di 51,2 Tb/s e oltre 66,5 miliardi di pacchetti al secondo.Routing adattivo, e RDMA, il QM9700-NS2R accelera il movimento dei dati e il calcolo in rete per i carichi di lavoro più esigenti.

- Switch Radix:64 porte 400G non bloccanti (32 connettori OSFP)

- Trasmissione:51.2 Tb/s aggregato bidirezionale

- Tasso di pacchetto:> 66,5 miliardi di pacchetti al secondo (BPPS)

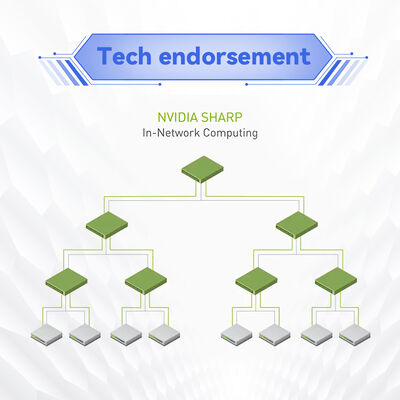

- SHARPv3:32x miglioramento dell'accelerazione AI rispetto alla generazione precedente

- Flusso d'aria:Corrente d'aria inversa da connettore a potenza (C2P), ideale per il contenimento dei corridoi caldi

- Gestione:Gestore di sottorete di bordo per un massimo di 2.000 nodi, MLNX-OS, CLI, WebUI, SNMP, JSON API

- Potenza e raffreddamento:1+1 PSU redundante a scambio caldo, ventilatori a scambio caldo, opzione da davanti a dietro o da dietro a davanti (configurazione C2P)

Costruita sulla piattaforma NVIDIA Quantum-2, la serie QM9700 ridefinisce la densità e l'efficienza di commutazione del data center.C2P airflow) integra 64 porte di 400Gb/s InfiniBand in un telaio compatto da 1USupporta la tecnologia port-split per fornire fino a 128 porte a 200 Gb/s, offrendo topologie flessibili come Fat Tree, DragonFly+, SlimFly e Torus multidimensionale.La retrocompatibilità con le precedenti generazioni di InfiniBand garantisce una integrazione agevole nell'infrastruttura esistenteCon telemetria avanzata, controllo della congestione e capacità di rete auto-riparazione, questo interruttore massimizza il throughput delle applicazioni semplificando le operazioni.

32 gabbie OSFP che supportano 400G NDR o 128x200G tramite cavi splitter, offrendo lo switch InfiniBand top-of-rack più denso in fattore di forma 1U.

Il protocollo di aggregazione e riduzione gerarchica scalabile di terza generazione NVIDIA accelera le operazioni collettive di IA fino a 32 volte, riducendo il movimento dei dati e la latenza.

L'accesso remoto diretto alla memoria (RDMA) e il routing adattivo eliminano i colli di bottiglia, mentre la mappatura virtuale delle corsie e il controllo delle congestioni migliorano le prestazioni.

Il failover automatico, la ritrasmissione a livello di collegamento e le capacità avanzate di monitoraggio garantiscono operazioni non interrompibili per carichi di lavoro mission-critical.

On-board subnet manager supporta fino a 2000 nodi out-of-the-box; gestione completa del telaio tramite CLI, WebUI, SNMP e JSON / REST API.

Ottimizzato per progetti di cluster scalabili ed economici; radix a doppia densità riduce i livelli di rete e riduce il costo totale di proprietà.

La piattaforma Quantum-2 integra la più recente tecnologia 400G SerDes di NVIDIA, fornendo 51,2 Tb/s di capacità di commutazione.SHARPv3L'interfaccia è stata progettata per consentire di utilizzare le tecnologie dell'informatica in rete, che scaricano le operazioni collettive dai nodi di calcolo, migliorando drasticamente l'efficienza dell'addestramento dell'IA.Accesso remoto diretto alla memoria (RDMA)Il routing adattivo distribuisce dinamicamente il traffico su più percorsi per evitare gli hotspot,mentre la qualità del servizio (QoS) migliorata e la mappatura della corsia virtuale (VL) garantiscono larghezza di banda per applicazioni criticheIl QM9700-NS2R incorpora anche telemetria avanzata per il monitoraggio in tempo reale del tessuto e capacità di auto-guarigione che reindirizzano automaticamente il traffico intorno ai guasti del collegamento.

- Cluster di AI e Machine Learning:Gli switch NDR ad alta radice consentono di utilizzare GPU supercomputing con SHARPv3 accelerando i collettivi NCCL.

- Centri di ricerca HPC:Le topologie SlimFly o Fat Tree collegano migliaia di nodi con latenza ultra-bassa per simulazioni meteorologiche, genomica e fisica.

- Centri dati aziendali:Consolidare il traffico est-ovest con l'architettura 400G, riducendo il numero di livelli e i costi operativi.

- Cloud & Hyperscale:DragonFly+ e toro multidimensionale per la massima scalabilità con elevata densità di larghezza di banda per unità rack.

- Immagazzinamento e espansione dell' IO:Collegare sistemi di storage ad alte prestazioni utilizzando NVMe over Fabrics (NVMe-oF) tramite InfiniBand.

Il QM9700-NS2R è completamente interoperabile con gli adattatori NVIDIA InfiniBand (ConnectX-6, ConnectX-7, ConnectX-8), i cavi ( rame attivo/passivo, fibra attiva, moduli ottici),e precedenti generazioni di FDR/EDR/HDR. Esegue MLNX-OS con ampio supporto API per framework di automazione. Compatibile con NVIDIA Unified Fabric Manager (UFM) per monitoraggio avanzato, analisi predittiva e telemetria.L'interruttore si integra perfettamente con i principali pianificatori HPC e gli strumenti di automazione delle reti aperte.

| Componente | Modelli/norme supportati |

|---|---|

| Adattatori di canale ospitante | NVIDIA ConnectX-6 / ConnectX-7 / ConnectX-8 InfiniBand, NDR 400G HCA |

| Cavi e trasmettitori | OSFP rame passivo (fino a 2,5 m), rame attivo, fibra attiva (fino a 500 m), moduli ottici (adattatori QSFP-DD a OSFP per 200G split) |

| Velocità InfiniBand precedenti | HDR (200Gb/s), EDR (100Gb/s), FDR (56Gb/s) |

| Gestione e automazione | MLNX-OS, UFM, Prometheus/Grafana tramite SNMP, JSON-RPC, moduli Ansible |

| Parametro | Specificità |

|---|---|

| Porti e velocità | 64 porte non bloccanti di 400Gb/s (NDR) InfiniBand; 32 connettori OSFP; supporta 128 porte @ 200Gb/s tramite cavi splitter |

| Capacità di cambio | 51.2 Tb/s di throughput bidirezionale aggregato; >66,5 miliardi di pacchetti al secondo (BPPS) |

| Latenza | Sub-130ns da porto a porto con routing dinamico (tipico) |

| Processore e memoria | x86 Coffee Lake i3, 8GB DDR4 SO-DIMM (2666 MT/s), 16GB M.2 SSD |

| Interfacce di gestione | 1x USB 3.0, 1x USB (I2C), 1x RJ45 (Ethernet), 1x RJ45 (UART) |

| Fornitore di energia | 1+1 ridondante, commutabile a caldo, 200-240Vac, 80 PLUS Gold+ certificato |

| raffreddamento e flusso d'aria | Flusso d'aria inverso da connettore a potenza (C2P) (modello NS2R); ventilatori intercambiabili a caldo, opzioni anteriore/posteriore |

| Dimensioni (HxWxD) | 1.7 pollici (43,6 mm) x 17,0 pollici (438 mm) x 26,0 pollici (660,4 mm) |

| Peso | 14.5 kg (31,97 libbre) |

| Condizioni di esercizio | Temperatura: da 0°C a 40°C; umidità: da 10% a 85% non condensabile; altitudine fino a 3050 m |

| Regolamentazione e sicurezza | RoHS, CE, FCC, VCCI, cTUVus, CB, RCM, Energy Star |

| Garanzia | Garanzia del fabbricante di 1 anno (estendibile) |

| Numero della parte ordinabile | Descrizione | Gestione | Direzione del flusso d'aria |

|---|---|---|---|

| MQM9700-NS2R | 64 porte 400Gb/s InfiniBand, switch gestito, 32 porte OSFP | Gestione completa della sottorete di bordo, MLNX-OS | C2P (Connector-to-Power) ️ flusso di aria inverso |

| MQM9700-NS2F | 64 porte 400Gb/s InfiniBand, switch gestito | Gestito (identiche caratteristiche) | Power-to-Connector (P2C) ️ flusso d'aria in avanti |

| MQM9790-NS2R | 64 porte 400Gb/s, switch non gestito | Gestione esterna non gestita dell'UFM | C2P flusso d'aria inverso |

| MQM9790-NS2F | 64 porte 400Gb/s, switch non gestito | Non gestito | Flusso d'aria in avanti P2C |

Il QM9700-NS2R è ideale per i clienti che richiedono una gestione avanzata on-box (subnet manager) e un flusso d'aria da connettore a alimentazione (gas di scarico a corridoio freddo).Confirmare la compatibilità del flusso d'aria con il design termico del centro dati prima di ordinare.

I magazzini e i partner di fornitura consentono una rapida spedizione in tutto il mondo con un imballaggio sicuro.

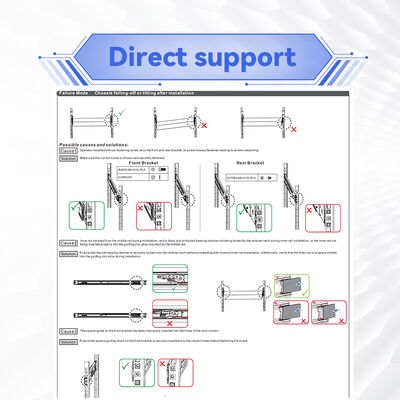

I nostri ingegneri interni aiutano a convalidare le topologie di rete, i piani di cablaggio e i requisiti del firmware.

Prezzi dei partner autorizzati con opzioni di garanzia estesa e programmi di sostituzione avanzati.

Supporto dedicato in inglese, mandarino, cantonese e lingue regionali per un approvvigionamento senza soluzione di continuità.

Starsurge fornisce supporto end-to-end per il ciclo di vita: dalla consulenza di progettazione alla distribuzione e alla manutenzione post-vendita.assistenza per l'aggiornamento del firmwarePer i progetti ad alto volume, offriamo una gestione dedicata degli account e una escalation tecnica 24 ore su 24, 7 giorni su 7.pacchetti di supporto estesi sono disponibili su richiesta.

L'unica differenza è la direzione del flusso d'aria: NS2R utilizza il flusso d'aria inverso da connettore a potenza (C2P), mentre NS2F utilizza il flusso d'aria in avanti da potenza a connettore (P2C).Scegliere in base alla progettazione termica del rack (corridoio caldo/corridoio freddo).

Sì, il QM9700 supporta la retrocompatibilità utilizzando cavi adattatori appropriati o opzioni di breakout per velocità HDR (200G), EDR (100G) e FDR (56G).Consulta la matrice di compatibilità o contatta Starsurge per gli SKU di cavo convalidati.

No, il QM9700-NS2R è dotato di un gestore di sottorete integrato in grado di gestire fino a 2000 nodi, semplificando le distribuzioni di piccole e medie dimensioni.

Sì, il tessuto InfiniBand è agnostico al fornitore del server. Qualsiasi server con un HCA InfiniBand supportato (ad esempio, serie ConnectX) può connettersi senza soluzione di continuità.

La potenza tipica varia in base alla configurazione delle porte e al cablaggio. Le PSU sono 1 + 1 ridondanti 200-240Vac, Gold +. Contattaci per una pianificazione dettagliata dell'energia.

- Assicurarsi che la direzione del flusso d'aria (C2P per NS2R) corrisponda alla strategia di ventilazione del rack per evitare il surriscaldamento.

- Utilizzare solo moduli NVIDIA OSFP approvati o cavi di rame/fibra passivi/attivi qualificati per prestazioni 400G.

- L'installazione deve essere effettuata secondo le precauzioni ESD e da personale qualificato della rete.

- Gli aggiornamenti del firmware devono essere eseguiti utilizzando le linee guida MLNX-OS per evitare interruzioni; pianificare le finestre di manutenzione di conseguenza.

Fondata nel 2008, Starsurge è un fornitore di hardware di rete, servizi IT e soluzioni di integrazione di sistemi basato sulla tecnologia.e delle imprese in tutto il mondoCon un team di vendite e tecnici esperti, forniamo attrezzature di rete affidabili tra cui switch, NIC, controller wireless, cavi e soluzioni IoT.Il nostro approccio basato sul cliente garantisce una scalabilitàIl supporto multilingue e le capacità di distribuzione a livello globale fanno di Starsurge il vostro partner di fiducia per le soluzioni NVIDIA e dei data center.

- Confirmare che la direzione del flusso d'aria (C2P) corrisponda al layout del data center

- Verificare l'input di potenza: 200-240V AC con alimentazioni ridondanti

- Selezionare i cavi/trascettori OSFP appropriati: rame attivo/passivo o fibra, in base alla distanza

- - pianificare la topologia della rete (Fat Tree, DragonFly+, ecc.) e i nodi di scalabilità

- ¢ Assicurarsi che gli adattatori host siano compatibili con NDR (ConnectX-7 o versione successiva per 400G)

- ¢ Allocare IP di gestione e rivedere le licenze MLNX-OS (senza licenza aggiuntiva per la commutazione core)

- Preparazione dello spazio per i rack: altezza 1U, profondità fino a 660 mm, inclusa la gestione dei cavi

Single/dual-port, PCIe 5.0, accelerazione per l'IA e l'HPC.

Versione non gestita per la gestione esterna dell'UFM, ideale per le implementazioni su larga scala.

Consente la connettività 200G ai server legacy o alle infrastrutture a bassa velocità.

Telemetria avanzata, monitoraggio predittivo e orchestrazione del tessuto.